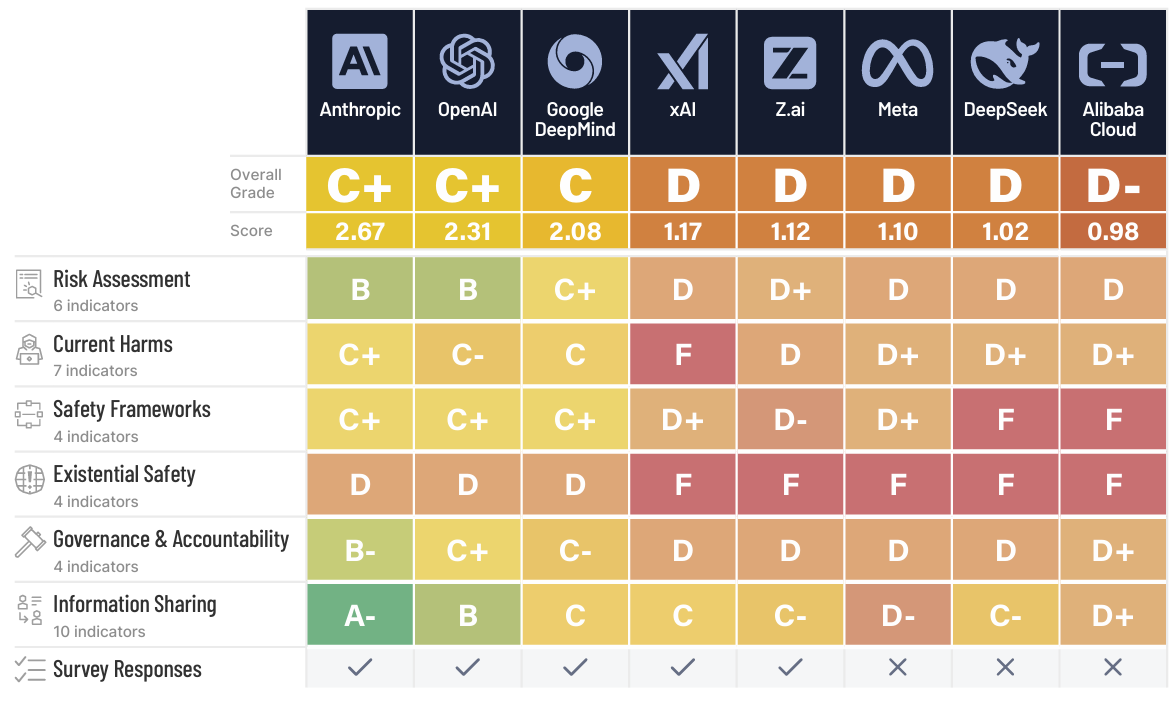

最新 AI 安全評估,全球領先人工智慧公司控制超智慧系統均獲不及格或近不及格分數,顯示這些公司追求超越人類智慧科技時,缺乏必要安全防護措施。未來生命研究所(Future of Life Institute)3 日公布 AI 安全指數,評估了八家主要 AI 公司生存風險、目前危害和安全等六方面。

雖然Anthropic、OpenAI和Google DeepMind整體評分名列前茅,獲C+至C,但安全措施方面,所有公司只獲D或F,顯示防止先進AI系統失控能力不足。加州大學柏克萊分校計算機科學教授Stuart Russell表示:「AI公司CEO都聲稱知道如何構建超人類AI,但沒有一家公司展示如何防止人類失去控制權。」

報告提到,這些公司承認災難性風險可能高達三分之一,卻缺乏詳細計畫將風險降至可接受水準。表現最佳公司與落後者差距也在擴大,xAI、Meta及中國DeepSeek、Z.ai和阿里雲等。所有公司目前危害均不理想,此為評估AI模型標準化信任基準表現,測試安全性、穩健性和控制有害輸出。

Anthropic這類得分最高為C+,xAI不及格。OpenAI評分從第二版B降至C-,部分原因是最近現實事件影響。評審建議「加強防制AI精神病和教唆自殺,並對所謂受害者採較低姿態」。

儘管所有測試模型都不算完全失敗,但各公司一致低分揭示AI業處理即時安全風險的系統性弱點,甚至考慮超智慧系統推測性危險前。五家公司為首次參加指數詳細評查,也提供前所未有的安全實踐透明度。然評審結論,即使表現最佳公司也未達新興監管標準,如歐盟AI行為準則和加州SB 53,獨立監管、透明威脅建模和可衡量風險閾值都仍有缺乏。

- Major AI companies fail safety test for superintelligence

- AI safety experts say most models are failing

- Future of Life Index grades AI labs poorly on existential safety

- Structuring AI Risk Management with ISO/IEC 42001

- The Year AI Turned on Its Makers: Bioweapons, Deepfakes, and the Security Gap No One Budgeted For

(首圖來源:shutterstock)