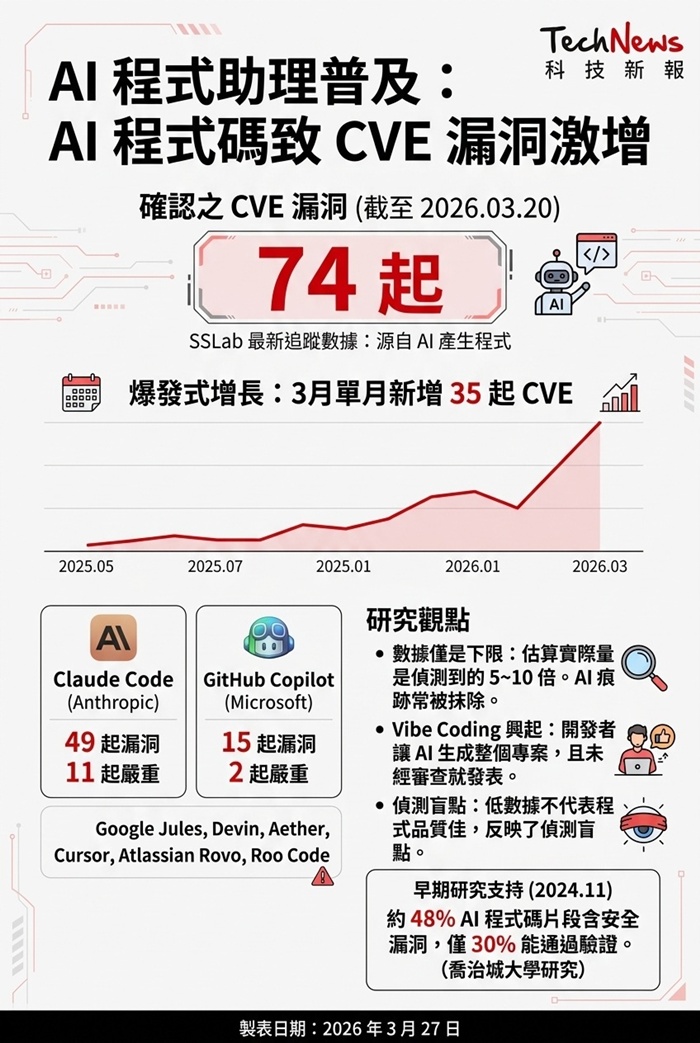

人工智慧(AI)程式助理迅速普及全球開發者社群,安全隱憂也日益突顯。喬治亞理工學院系統與軟體安全實驗室(SSLab)最新追蹤數據,截至 2026 年 3 月 20 日,研究員確認至少 74 起 CVE(常見漏洞與披露)漏洞直接源於 AI 產生程式。

這項研究自 2025 年 5 月 1 日開始記錄,數據顯示 AI 漏洞近期呈爆發式增長。僅 3 月研究員就認出 35 起新 AI 相關 CVE(27 起為 Claude Code 產生,四起為 GitHub Copilot 產生,兩起由 Devin 產生,Aether 與 Cursor 各一起)。Anthropic 的 Claude Code 因近期使用量激增尤其突出,共與 49 起漏洞(11 起為嚴重等級)有關;GitHub Copilot 為 15 起(兩起為嚴重等級)。此外,Aether、Google Jules、Devin、Cursor、Atlassian Rovo 及 Roo Code 等工具也均有漏洞紀錄。

研究員指出,目前數據只是冰山一角。SSLab 研究員 Hanqing Zhao 表示,這 74 起案例是有明確證據顯示 AI 參與開發的「下限」,而非實際比例。許多 AI 痕跡在程式提交前會抹除,團隊估算實際漏洞量可能是偵測到 5~10 倍。以開源專案 OpenClaw 為例,雖有超過 300 項安全建議,但僅能確認約 20 起有清晰 AI 訊號。

開發模式轉變加劇風險。過去開發者多用 AI 自動補全,但現在「Vibe Coding」興起,開發者傾向讓 AI 產生整個專案,且未仔細審查就發表。目前 Claude Code 在 GitHub 公共提交紀錄佔比超過 4%,若 AI 程式真如數據所示安全,安全性應比人類程式高數級,研究員認為現在顯然不符事實,低數據反映出偵測盲點而非程式品質更佳。

喬治城大學安全與新興技術中心早期研究(2024 年 11 月發表)也支持這觀察。測試顯示,GPT-3.5-turbo、GPT-4、Code Llama 7B Instruct、WizardCoder 7B 與 Mistral 7B Instruct 等模型寫程式片段,約 48% 雖可編譯,但含安全漏洞,僅約 30% 程式能通過嚴格安全驗證。

- Using AI to code does not mean your code is more secure

- Researchers Sound the Alarm on Vulnerabilities in AI-Generated Code

- State of AI Cybersecurity 2026: 92% of Security Pros Concerned About AI Agents

- AI coding: security risks, controls, and policies

- The Security Risks of AI-Generated Code: What Vibe Coding Really Costs You

(首圖來源:shutterstock)